开yun体育网

开yun体育网

这项由台湾大学通信工程学接头所的张凯波、郑维元等接头者,以及英伟达公司的王宇祥等群众调解完成的接头,发表于2025年12月的arXiv预印本平台。有兴味深入了解的读者不错通过论文编号arXiv:2512.04356v1查询好意思满论文。

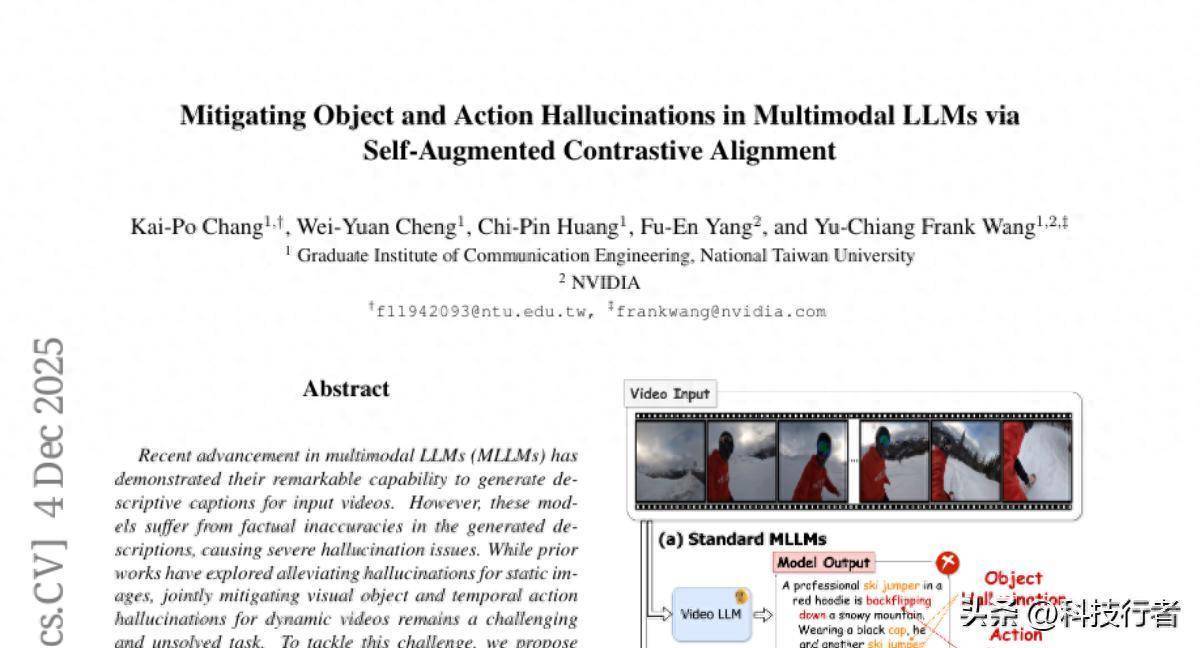

当咱们看到一段视频时,约略准确态状其中的物体和动作似乎是理所天然的事情。然则关于东说念主工智能来说,这个看似简便的任务却荫藏着顽强的挑战。现在的多模态大谈话模子诚然约略生成畅通的视频态状,但常常出现严重的"幻觉"问题——也便是说,它们会态状视频中根底不存在的物体和动作。

推敲这么一个场景:当你条目AI态状一段滑雪视频时,它可能会告诉你视频中有东说念主在跳伞,或者宣称看到了根底不存在的雪橇。这种诞妄不单是是小问题,在医疗会诊或自动驾驶等需要高度准确性的边界,这么的诞妄可能带来严重后果。

传统的不休决议大多专注于静态图像的物体幻觉问题,但视频包含了时刻维度,动作的准确识别成为了愈加复杂的挑战。接头团队顽强到,要不休这个问题,需要同期处理两个层面:一是让AI正确识别视频中的物体,二是准确交融这些物体之间的动作关系。

接头团队确立了一个名为SANTA的翻新框架,这个名字代表"自增强对比对王人"。这个框架的中枢想想访佛于一个教训丰富的老诚在转变学生的诞妄:最初识别学生容易犯的诞妄类型,然后针对性地假想熟练来转变这些诞妄。

SANTA框架的第一个翻新在于"幻觉性自增强"机制。这个机制的责任道理很像一个反面讲义的相聚器。当AI模子生成视频态状时,系统会特地让它取舍那些诚然听起来合理但骨子上诞妄的词汇。比如,当真实视频中有东说念主在"立正"时,系统可能会记载下AI倾向于说成"坐着"的诞妄倾向。通过相聚这些"反面讲义",系统就能更好地交融AI容易在哪些方位出错。

更具体地说,这个经由就像制作一册"常见诞妄手册"。系统会让AI在每个生成步伐中取舍概率最高但又不属于正确谜底连络的词汇。正确谜底连络包括视频中真实存在的物体和动作,以及它们的同义词和上位词。通过这种方式,系统不错系统性地发现AI的"想维盲区"。

SANTA的第二个中枢翻新是"轨迹-短语对比对王人"机制。传统步伐时时将视频算作一系列独处的图片来处理,这么就无法捕捉物体在时刻上的陆续性和动作的好意思满经由。新的方国法像一个认确实不雅察者,不仅关心每个骤然的画面,还跟踪物体在总计这个词视频经由中的灵通轨迹。

这个轨迹跟踪经由使用了最新的视觉定位技能,约略精准标志出每个物体在视频中的位置变化。同期,系统还引入了一个"动作压缩器"模块,专门负责从物体之间的关系变化中索求动作信息。这就像一个专门分析跳摆动作的老诚,不仅看每个舞者的位置,还要交融他们之间的协调关系。

动作压缩器聘请了感知器架构,使用一组可学习的查询向量来捕捉不同类型的动作模式。当系统分析一个动作时,会让这些查询向量与计议物体的轨迹特征进行交互,然后选出最能代表面前动作的查询完了。这个经由确保了系统约略从复杂的空间-时刻关系中索求出准确的动作信息。

总计这个词老练经由聘请了对比学习的战略,这种战略的责任道理访佛于"正反对比"的素养步伐。系统同期学习正确的态状应该是什么样的,以及诞妄的态状是什么样的。通过接续强化正确的关联,同期扼制诞妄的关联,AI模子冉冉学会生成愈加准确和可靠的视频态状。

为了考证SANTA框架的有用性,接头团队在多个巨擘数据集上进行了全面的实际。他们使用了MiraData数据集进行老练,这个数据集包含了42715个高质地的视频-文本对,每个视频平均长度为72.1秒,态状文本平均长度达到318个词。

实际完了令东说念主印象长远。在MiraData-9k测试集上,SANTA在物体幻觉评估方面比现存最好步伐平均进步了4.02%,在动作幻觉评估方面进步了5.54%。更蹙迫的是,在加权评估意见下,这些进步永别达到了3.77%和7.7%。

接头团队还在FactVC数据集上进行了考证,这个数据集专门用于评估视频态状的事实准确性。完了夸耀,SANTA在精准率、调回率和F1分数等关键意见上都达到了最好阐述。在视频问答任务VidHal上,SANTA在物体和动作计议的问题酬报准确率上永别达到了86.3%和85.8%,杰出了总计对比步伐。

极端值得关心的是,接头团队通过t-SNE可视化技能展示了SANTA的责任机制。可视化完了明晰地夸耀,在支配SANTA之前,正确的视频-文本特征和诞妄的幻觉特征在特征空间中搀杂在全部,界限不清。而在支配SANTA之后,这两类特征被显着分开,诞妄的幻觉特征被有用地从正确特征平分离出来。

为了测试步伐的普适性,接头团队在不同的基础模子上进行了考证。除了在LLaVA-Video模子上取得显贵进步外,在Qwen2.5-VL模子上也赢得了一致的改进完了,讲授了SANTA框架的通用性和贯通性。

接头还深入分析了各个组件的孝敬。实际标明,仅添加物体级别的对王人就能带来显贵进步,而进一步加入动作级别的对王人则能赢得稀奇的改进。好意思满的SANTA框架在总计评估意见上都达到了最好完了,讲授了各个组件之间的协同作用。

值得一提的是,接头团队还测试了SANTA在通用视频态状任务上的阐述。在Dream1k基准测试中,SANTA不仅减少了幻觉同意,还进步了举座的视频态状质地,从32.5分进步到32.7分。这讲授了提高态状准确性并不会毁伤模子的抒发才智,反而约略增强其举座性能。

关于物体轨迹质地的影响分析也很有启发性。即使在使用较低置信度阈值(从0.25降到0.15)导致更多误检的情况下,SANTA仍然约略保抓贯通的性能进步,夸耀了其对噪声的鲁棒性。

从技能竣事的角度来看,SANTA的老练经由相对高效。接头团队聘请了6e-5的学习率,批次大小为64,使用64帧均匀采样,在2000个老练步伐内就能达到瞎想完了。动作压缩器模块聘请了16个可学习查询,均衡了盘算着力和表征才智。

这项接头的道理道理远远超出了技能层面的改进。在医疗影像分析中,准确的视频态状约略匡助医师更好地交融病理经由。在自动驾驶边界,可靠的场景交融对安全性至关蹙迫。在陶冶技能中,准确的视频内容分析约略为个性化学习提供更好的营救。

天然,这项接头也有一些舍弃。现在的步伐主要针对相对露馅的视频内容,关于很是腌臜或复杂场景的处理才智仍有进步空间。此外,步伐的盘算复杂度诚然相对可控,但在处理超长视频时仍需要进一步优化。

瞻望明天,这项接头为多模态AI的发展指明了蹙迫意见。通过勾通自增强学习和细粒度对比对王人,SANTA框架不仅不休了面前的技能痛点,也为后续接头提供了可贵的想路。跟着视频内容的爆炸式增长和AI支配场景的接续彭胀,这种约略准确交融和态状视频内容的技能将阐述越来越蹙迫的作用。

说到底,让AI约略像东说念主类相通准确交融视频内容,一直是东说念主工智能边界的蹙迫意见。SANTA框架通过神秘的假想,让AI不仅约略"看见"视频中的物体,更约略"交融"它们之间的动作关系。这种越过不单是是技能上的冲破,更是让AI更接近确凿交融天下的蹙迫一步。关于芜俚东说念主来说,这意味着明天的AI助手将约略更准确地匡助咱们分析视频内容,无论是整理家庭摄像、协助责任陈述,已经扶助专科分析,都将变得愈加可靠和实用。

Q&A

Q1:什么是SANTA框架?

A:SANTA是"自增强对比对王人"框架的简称,由台湾大学和英伟达调解确立,专门用于不休AI在态状视频时出现的"幻觉"问题。它能让AI准确识别视频中真实存在的物体和动作,幸免态状不存在的内容。

Q2:AI视频态状中的"幻觉"问题有多严重?

A:这个问题相配严重,现在的AI常常会态状视频中根底不存在的物体和动作。比如看滑雪视频时说成跳伞,或者看到不存在的物品。在医疗会诊、自动驾驶等关键支配中,这种诞妄可能带来严重后果。

Q3:SANTA框架比拟传统步伐有什么上风?

A:SANTA的中枢上风是同期处理物体和动作两个层面的准确性。它不仅能识别视频中的物体,还能交融物体间的动作关系。实际夸耀,它在物体准确性上进步4.02%,动作准确性上进步5.54%,显贵杰出现存步伐。